近年來,隨著大型語言模型(LLM)如 ChatGPT 的崛起,維基百科面臨了前所未有的挑戰,其中包括大量使用 AI 自動生成的內容。這些內容對維基百科的可靠性、編輯標準以及社群管理提出了嚴峻考驗。本文將以流程指南的形式,幫助你理解維基百科禁止 AI 生成內容的決策流程與背後的關鍵因素。

在開始深入討論之前,你需要了解此流程適用於想要理解維基百科內容政策調整的讀者,無論是維基百科的熱心編輯、研究人員,或是資訊科技領域的關注者。

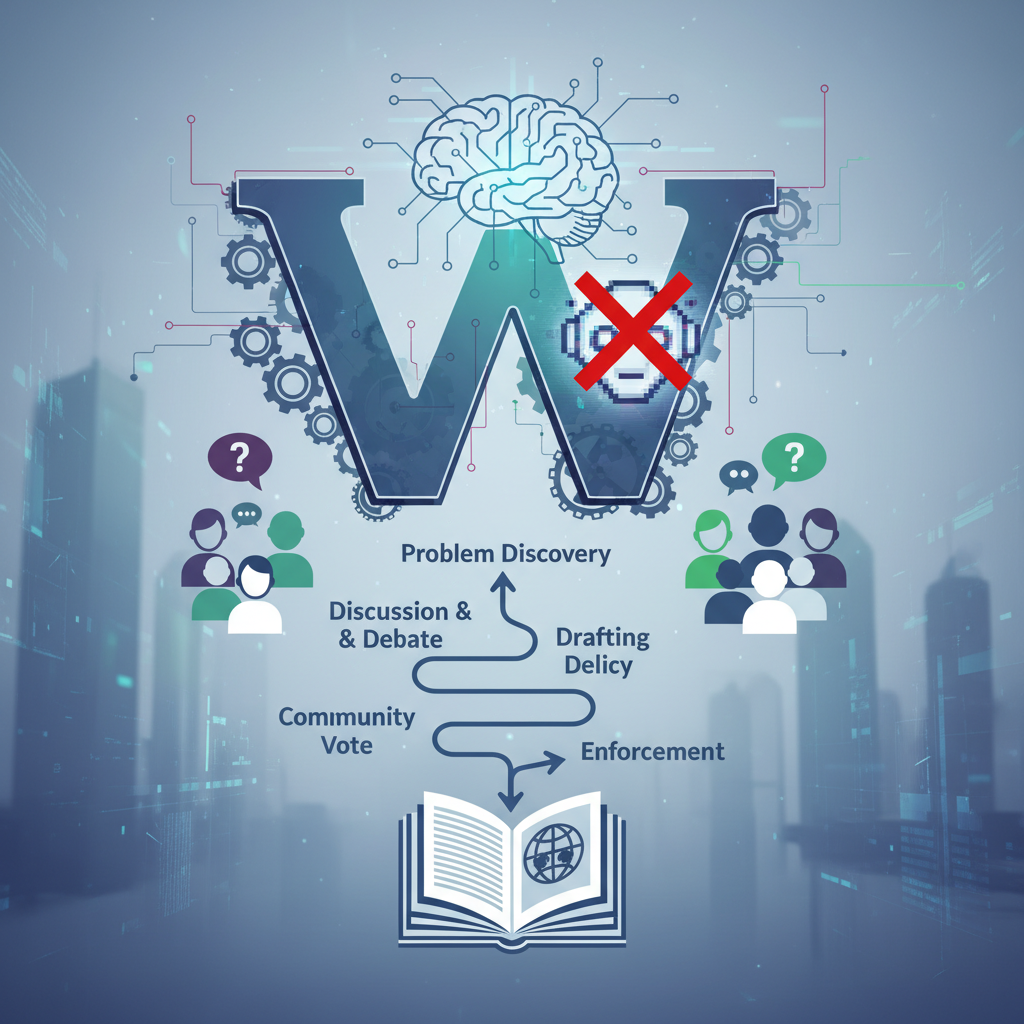

整體流程可拆分為以下四個主要階段:

第一階段:問題識別與社群回饋

第二階段:影響評估與內部討論

第三階段:政策制定與正式公告

第四階段:執行監管與持續調整

以下將依序說明每個階段的重點,並提供實際操作建議與理解心理。

第一階段:問題識別與社群回饋

於此階段,維基百科的管理團隊及核心編輯觀察到近月來越來越多關於 LLM 生成內容的行政報告。大量 AI 生成的條目讓編輯與審核工作負擔劇增,編輯熱情遭受衝擊。這時候,作為一名社群成員,可以積極參與討論版,提出自身觀察與經驗,協助呈現問題全貌。

心理層面而言,許多編輯感到迷惘與焦慮:如何分辨 AI 文章與人工作品?這樣的趨勢是否會稀釋維基百科的公信力?否認或忽視問題只會延長矛盾,但積極參與溝通能幫助整個社群找出更平衡的方案。

常見誤解:認為 AI 生成內容必然是低質量或惡意內容,但並非所有 AI 產品皆如此,重點在於審核機制與標準制定。

第二階段:影響評估與內部討論

確定問題後,維基百科管理團隊展開深入評估,包括對 LLM 生成內容的可靠性、維護負擔與未來可能風險的分析。在此過程中,不同意見並存,一部分支持技術創新,另一部分則強調維基百科的自律精神與內容品質。

從管理人的視角,看似艱難的抉擇在於權衡包容技術發展與堅守編輯標準。「我們該怎樣才不會失去長期累積的價值?」這是許多決策者內心的提問。

常見誤會包括忽略 AI 生成內容對審核速度造成的拖延,或過度擔心技術替代編輯者,導致討論一邊倒。

第三階段:政策制定與正式公告

經過討論與多輪共識建構,維基百科社群決定制定禁止或限制 AI 生成內容的政策。這類政策通常包括:明確定義人工智慧內容,要求揭露來源,禁止未經人工審核的內容上架等。公告階段也包含教學與宣導工作,讓所有編輯者明白變革的必要性與細節。

此時,作為編輯可以主動學習新政策,調整自己的編輯行為。例如,避免依賴 AI 產生的內容直接填充條目,並協助審核同儕的貢獻。

經歷這階段,部分編輯可能會有抗拒情緒,因為這限制了使用新技術的彈性,但換個角度思考,這是為了確保資訊真實與長遠發展。

常見誤區:以為禁止完全禁止任何 AI 相關輔助,其實政策主要聚焦在提高透明度與審核嚴格度。

第四階段:執行監管與持續調整

政策發布後,維基百科會持續透過社群監督與管理員工具強化執行,並根據實際狀況調整規範。此時,編輯與管理員需維持高敏感度,辨識與處理違規內容,並參與後續政策評論。

心理面而言,這是社群共治的關鍵時刻。「我的貢獻是否貼合新標準?」「該如何在限制中發揮創意?」都是編輯者需要思考的問題。

常見誤解為以為政策一經定案即不變,事實上規範是動態調整的過程,需依據技術與社群狀況靈活修正。

總結來說,了解「Wikipedia 如何禁止 AI 生成內容」的流程,是一個從問題察覺到政策執行的循序漸進過程。對社群成員與關注者而言,掌握每個階段的脈絡與挑戰,有助於理解維基百科作為全球最大自由百科全書維護公信力的努力。

若你是維基百科的新編輯或熱心讀者,建議密切關注官方公告與討論版,參與社群共治,讓維基百科持續成為知識共享的可靠平台。

You may also like: 維基百科禁止 AI 生成內容:編輯團隊的最新挑戰與因應

learn more about: 瞭解數字資產入門知識,搭建數字資產基礎認知